تفاوت انتقال یادگیری و فاینتیونینگ در یادگیری عمیق

در حوزه یادگیری عمیق، بهرهگیری از مدلهای از پیش آموزشدیده به یک تکنیک اساسی برای دستیابی به نتایج پیشرفته در وظایف مختلف تبدیل شده است، بهویژه هنگام مواجهه با دادههای محدود. فاینتیونینگ (Fine-tuning) و انتقال یادگیری (Transfer Learning) هر دو به مدلها اجازه میدهند از دانش آموختهشده از یک وظیفه برای بهبود عملکرد در وظیفه دیگر استفاده کنند. این روشها ممکن است در نگاه اول مشابه به نظر برسند، اما از نظر نحوه کاربرد و مکانیزمهای زیربنایی تفاوتهای مشخصی دارند.

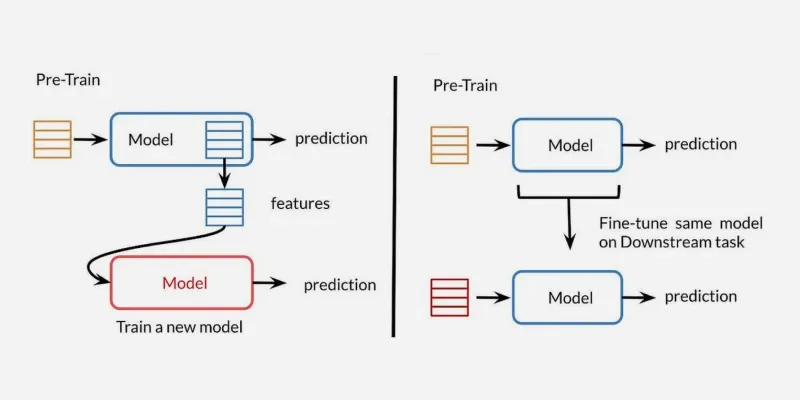

انتقال یادگیری (Transfer Learning) شامل استفاده از ویژگیهای یک مدل از پیش آموزشدیده و بازآموزی تنها لایههای نهایی برای یک وظیفه جدید است.

در حالی که فاینتیونینگ (Fine-tuning) وزنهای کل مدل (یا زیرمجموعهای از لایهها) را برای سازگاری بهتر آن با وظیفه جدید تنظیم میکند. فاینتیونینگ انعطافپذیری بیشتری فراهم میکند اما به داده و محاسبات بیشتری نیاز دارد.

تفاوتهای کلیدی بین فاینتیونینگ و انتقال یادگیری

۱. محدوده آموزش

- انتقال یادگیری (Transfer Learning): معمولاً، فقط لایههای نهایی روی وظیفه جدید آموزش میبینند، در حالی که بقیه مدل از پیش آموزشدیده freeze میشود. ایده این است که از ویژگیهای آموختهشده از مدل از پیش آموزشدیده استفاده کرده و آنها را برای وظیفه جدید سازگار کنیم.

- فاینتیونینگ (Fine-Tuning): شامل تنظیم وزنهای کل مدل (یا حداقل زیرمجموعهای از لایهها) است، که به این معنی است که مدل فرصت یادگیری بیشتر و تخصصی شدن در وظیفه جدید را دارد. این امکان را میدهد که هم لایههای استخراج ویژگی و هم لایههای طبقهبندی با مجموعه داده هدف سازگار شوند.

۲. نیازمندیهای داده

- انتقال یادگیری: از آنجا که مدل از پیش آموزشدیده قبلاً ویژگیهای عمومی مفیدی را ثبت کرده است، انتقال یادگیری میتواند حتی زمانی که مجموعه داده جدید کوچک است، بسیار مؤثر باشد. شما فقط نیاز به بازآموزی لایههای نهایی دارید، که معمولاً به داده بسیار کمتری نیاز دارد.

- فاینتیونینگ: فاینتیونینگ ممکن است به داده بیشتری نسبت به انتقال یادگیری نیاز داشته باشد زیرا مدل به طور کاملتری تنظیم میشود. در نتیجه، ممکن است برای دستیابی به عملکرد بهینه بدون بیشبرازش (overfitting) به مجموعه داده نسبتاً بزرگتری نیاز داشته باشید.

۳. هزینه محاسباتی

- انتقال یادگیری: از آنجا که فقط چند لایه آخر بازآموزی میشوند، انتقال یادگیری از نظر محاسباتی کم هزینهتر و سریعتر است. این آن را برای موقعیتهایی که منابع محدود هستند، ایدهآل میسازد.

- فاینتیونینگ: فاینتیونینگ میتواند از نظر محاسباتی پرهزینهتر باشد زیرا کل مدل (یا چندین لایه) بازآموزی میشود، که زمان آموزش و نیازهای محاسباتی را افزایش میدهد.

۴. سازگاریپذیری

- انتقال یادگیری: مدل بیشتر احتمال دارد ویژگیهای عمومی که از مجموعه داده اصلی یاد گرفته را حفظ کند، و توانایی آن برای سازگاری با وظایف جدید ممکن است به آنچه میتواند از تغییر لایههای نهایی یاد بگیرد، محدود شود.

- فاینتیونینگ: فاینتیونینگ انعطافپذیری بیشتری برای سازگاری با وظیفه هدف ارائه میدهد زیرا لایههای بیشتری تنظیم میشوند. این بهویژه زمانی مفید است که وظیفه منبع و وظیفه هدف کاملاً متفاوت باشند، یا زمانی که وظیفه جدید ظرافتهای خاصی دارد که به رفتار مدل سفارشیتر نیاز دارد.

۵. خطر بیشبرازش

- انتقال یادگیری: از آنجا که مدل فقط لایههای نهایی خود را بهروزرسانی میکند، خطر بیشبرازش زمانی که مجموعه داده کوچکتری دارید، کمتر است.

- فاینتیونینگ: فاینتیونینگ میتواند خطر بیشبرازش را افزایش دهد، بهویژه اگر مجموعه داده کوچک باشد و مدل پارامترهای بسیار زیادی برای تنظیم داشته باشد. تکنیکهای regularization مانند حذف تصادفی (dropout) یا توقف زودهنگام (early stopping) ممکن است برای جلوگیری از بیشبرازش ضروری باشند.

جدول خلاصه تفاوتهای بین انتقال یادگیری و فاینتیونینگ:

| جنبه | انتقال یادگیری (Transfer Learning) | فاینتیونینگ (Fine-Tuning) |

|---|---|---|

| محدوده آموزش | فقط لایههای نهایی بازآموزی میشوند؛ بقیه مدل freeze میشود. | کل مدل (یا لایههای خاص) بازآموزی میشود، که سازگاری بیشتری را امکانپذیر میسازد. |

| نیازمندیهای داده | به دلیل استفاده مجدد از ویژگیهای از پیش آموختهشده، با مجموعه دادههای کوچکتر به خوبی کار میکند. | ممکن است به داده بیشتری نیاز داشته باشد زیرا مدل به طور کاملتری تنظیم میشود. |

| هزینه محاسباتی | کم هزینهتر از نظر محاسباتی زیرا فقط لایههای نهایی آموزش میبینند. | پرهزینهتر از نظر محاسباتی به دلیل بازآموزی کل مدل یا لایههای بیشتر. |

| سازگاریپذیری | سازگاری محدود با وظایف جدید؛ عمدتاً لایههای نهایی را تغییر میدهد. | سازگاری بیشتر با وظایف جدید، تنظیم هر دو لایه استخراج ویژگی و لایههای طبقهبندی. |

| خطر بیشبرازش | خطر کمتر بیشبرازش با مجموعه دادههای کوچکتر زیرا فقط لایههای نهایی آموزش میبینند. | خطر بالاتر بیشبرازش، بهویژه با مجموعه دادههای کوچک و تعداد زیادی از پارامترهای قابل آموزش. |

چه زمانی از انتقال یادگیری در مقابل فاینتیونینگ استفاده کنیم

انتقال یادگیری (Transfer Learning) معمولاً بهترین انتخاب است زمانی که:

- مجموعه داده کوچکی برای وظیفه جدید دارید.

- وظیفه جدید نسبتاً مشابه وظیفه اصلی است (مثلاً طبقهبندی تصاویر حیوانات در مقابل طبقهبندی انواع دیگر اشیاء).

- به یک راهحل سریع با حداقل منابع محاسباتی نیاز دارید.

فاینتیونینگ (Fine-Tuning) انتخاب بهتری است زمانی که:

- مجموعه دادهای به اندازه کافی بزرگ برای بازآموزی لایههای بیشتری از مدل بدون بیشبرازش (overfitting) دارید.

- وظیفه جدید تا حدودی با وظیفه اصلی متفاوت است و نیاز به سازگاری گستردهتر مدل دارد.

- منابع محاسباتی و زمان بیشتری برای آموزش مدل دارید.

درک اینکه چه زمانی و چگونه از این روشها استفاده کنیم میتواند به طور قابل توجهی عملکرد مدلهای یادگیری ماشین را بهبود بخشد، بهویژه زمانی که با دادههای محدود کار میکنید یا در سناریوهایی که آموزش یک مدل از ابتدا از نظر محاسباتی پرهزینه خواهد بود.

برای تسلط به مفاهیم یادگیری عمیق و همچنین تسلط به پیاده سازی، همین امروز با دوره آموزشی جامع یادگیری عمیق شروع کنید.

دوره جامع یادگیری عمیق: تسلط بر هوش مصنوعی با 40 ساعت آموزش (Tensorflow/keras)

منبع: https://www.geeksforgeeks.org/what-is-the-difference-between-fine-tuning-and-transfer-learning/

دیدگاهتان را بنویسید