مدلهای زبانی بینایی (Vision Language Models)

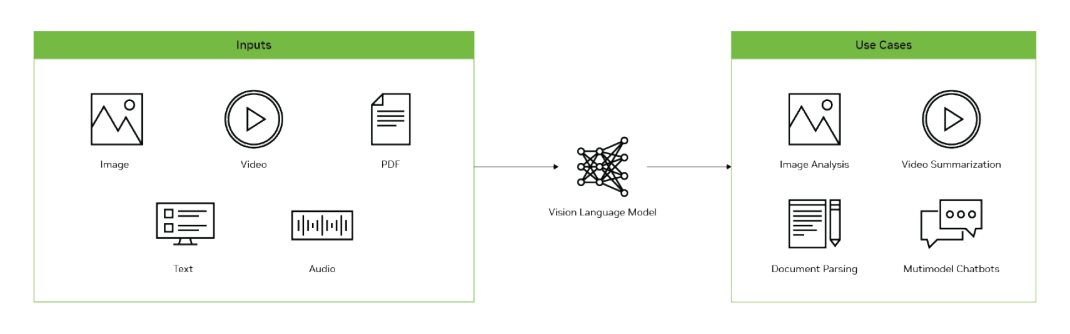

مدلهای زبانی بینایی (VLMs) مدلهای هوش مصنوعی چندحالته و مولد هستند که قادر به درک و پردازش ویدیو، تصویر و متن میباشند.

مدلهای زبانی بینایی چیست؟

مدلهای زبانی بینایی سیستمهای هوش مصنوعی چندحالتهای هستند که با ترکیب یک مدل زبانی بزرگ (LLM) با یک رمزگذار بینایی ساخته شدهاند، که به LLM توانایی “دیدن” میدهد.

با این قابلیت، VLMها میتوانند ورودیهای ویدیویی، تصویری و متنی ارائه شده در پرامپت را پردازش کرده و درک پیشرفتهای از آنها ارائه دهند تا پاسخهای متنی تولید کنند.

برخلاف مدلهای سنتی بینایی کامپیوتر، مدلهای زبانی بینایی (VLMs) به مجموعه ثابتی از کلاسها یا وظیفه خاصی مانند طبقهبندی یا تشخیص محدود نیستند. این مدلها که روی مجموعه عظیمی از متون و جفتهای تصویر/ویدیو-توضیح بازآموزی شدهاند، میتوانند با زبان طبیعی هدایت شوند و برای انجام بسیاری از وظایف کلاسیک بینایی به علاوه وظایف جدید مبتنی بر هوش مصنوعی مولد مانند خلاصهسازی و پرسش و پاسخ بصری استفاده شوند.

چرا مدلهای زبانی بینایی مهم هستند؟

برای درک اهمیت مدلهای زبانی بینایی (VLMs)، آگاهی از نحوه کارکرد مدلهای سنتی بینایی کامپیوتر (CV) مفید است. مدلهای سنتی CV مبتنی بر شبکههای عصبی کانولوشنی (CNN) برای یک وظیفه خاص روی مجموعه محدودی از کلاسها آموزش داده میشوند. به عنوان مثال:

- یک مدل طبقهبندی که تشخیص میدهد آیا یک تصویر حاوی گربه است یا سگ

- یک مدل CV تشخیص و بازشناسی کاراکتر نوری (OCR) که متن را در تصویر میخواند اما قالب یا هرگونه داده بصری درون سند را تفسیر نمیکند

مدلهای CV قبلی برای هدف خاصی آموزش دیده بودند و توانایی فراتر رفتن از وظیفه یا مجموعه کلاسهایی که برای آن توسعه یافته و آموزش دیده بودند را نداشتند. اگر مورد استفاده به هر شکلی تغییر میکرد یا نیاز به افزودن کلاس جدیدی به مدل داشت، توسعهدهنده باید تعداد زیادی تصویر جمعآوری و برچسبگذاری میکرد و مدل را دوباره آموزش میداد. این فرآیندی پرهزینه و زمانبر است. علاوه بر این، مدلهای CV هیچ درکی از زبان طبیعی ندارند.

VLMها با ترکیب قدرت مدلهای پایه مانند CLIP و LLMها، کلاس جدیدی از قابلیتها را ارائه میدهند تا هم تواناییهای بینایی و هم زبانی داشته باشند. VLMها به صورت پیشفرض عملکرد قوی zero-shot در انواع وظایف بینایی مانند پاسخگویی به سؤالات بصری، طبقهبندی و تشخیص کاراکتر نوری دارند. آنها همچنین بسیار انعطافپذیر هستند و میتوانند نه فقط برای مجموعه ثابتی از کلاسها، بلکه برای تقریباً هر مورد استفادهای با تغییر ساده پرامپت متنی به کار روند.

استفاده از VLM بسیار شبیه به تعامل با LLM است. کاربر پرامپتهای متنی را ارائه میدهد که میتواند با تصاویر درهم آمیخته شود. ورودیها سپس برای تولید خروجی متنی استفاده میشوند. پرامپتهای ورودی باز هستند و به کاربر اجازه میدهند تا به VLM دستور دهد به سؤالات پاسخ دهد، خلاصه کند، محتوا را توضیح دهد یا با تصویر استدلال کند. کاربران میتوانند با VLM گفتگو کنند و قابلیت افزودن تصاویر به زمینه مکالمه را دارند. VLMها همچنین میتوانند در عاملهای بصری ادغام شوند تا به طور خودکار وظایف بینایی را انجام دهند.

چگونه مدلهای زبانی بینایی کار میکنند؟

اکثر VLMها از معماری سه بخشی پیروی میکنند:

- یک رمزگذار بینایی (vision encoder)

- یک پروجکتور (projector)

- یک مدل زبانی بزرگ (LLM)

رمزگذار بینایی معمولاً یک مدل مبتنی بر CLIP با معماری ترنسفورمر است که روی میلیونها جفت تصویر-متن آموزش دیده است و به آن توانایی ارتباط تصاویر و متن را میدهد. پروجکتور مجموعهای از لایههاست که خروجی رمزگذار بینایی را به فرمی که LLM بتواند درک کند، ترجمه میکند که اغلب به عنوان توکنهای تصویر تفسیر میشود. این پروجکتور میتواند یک لایه خطی ساده مانند LLaVA و VILA باشد، یا چیزی پیچیدهتر مانند لایههای توجه متقاطع (cross-attention) که در Llama 3.2 Vision استفاده میشود.

هر LLM آماده میتواند برای ساخت یک VLM استفاده شود. صدها نوع مختلف VLM وجود دارد که LLMهای مختلف را با رمزگذارهای بینایی ترکیب میکنند.

چگونه مدلهای زبانی بینایی آموزش داده میشوند؟

مدلهای زبانی بینایی (VLMs) در چندین مرحله آموزش داده میشوند که شامل پیشآموزش (pretraining) و سپس تنظیم دقیق نظارتشده (supervised fine-tuning) است. به صورت اختیاری، تنظیم دقیق کارآمد پارامتر (PEFT) میتواند به عنوان مرحله نهایی برای ایجاد یک VLM مختص دامنه روی دادههای سفارشی اعمال شود.

مرحله پیشآموزش، رمزگذار بینایی، پروجکتور و LLM را هماهنگ میکند تا اساساً هنگام تفسیر ورودی متن و تصویر به زبان یکسانی صحبت کنند. این کار با استفاده از مجموعههای بزرگ متن و تصاویر با جفتهای تصویر-توضیح و دادههای متن-تصویر درهمآمیخته انجام میشود. پس از اینکه سه جزء از طریق پیشآموزش هماهنگ شدند، VLM از یک مرحله تنظیم دقیق نظارتشده عبور میکند تا به آن کمک شود نحوه پاسخگویی به پرامپتهای کاربر را درک کند.

دادههای مورد استفاده در این مرحله ترکیبی از پرامپتهای نمونه با ورودی متن و/یا تصویر و پاسخ مورد انتظار از مدل هستند. به عنوان مثال، این دادهها میتوانند پرامپتهایی باشند که به مدل میگویند تصویر را توصیف کند یا تمام اشیاء موجود در قاب را بشمارد، همراه با پاسخ صحیح مورد انتظار. پس از این مرحله آموزش، VLM درک خواهد کرد که چگونه به بهترین شکل تصاویر را تفسیر کرده و به پرامپتهای کاربر پاسخ دهد.

پس از آموزش VLM، میتوان از آن به همان روش LLM با ارائه پرامپتهایی که میتوانند شامل تصاویر درهمآمیخته با متن باشند، استفاده کرد. سپس VLM بر اساس ورودیها، یک پاسخ متنی تولید خواهد کرد. VLMها معمولاً با یک رابط API REST به سبک OpenAI مستقر میشوند تا تعامل با مدل آسان شود.

تکنیکهای پیشرفتهتری در حال حاضر برای بهبود قابلیتهای بینایی در حال تحقیق هستند:

- ادغام رمزگذارهای بینایی برای پردازش ورودیهای تصویری

- تقسیم ورودیهای تصویری با وضوح بالا به کاشیهای کوچکتر برای پردازش

- افزایش طول زمینه برای بهبود درک ویدیوهای طولانی

تمام این پیشرفتها، قابلیتهای VLMها را از درک تنها ورودی تکتصویری به مدلهایی با توانایی بالا که میتوانند تصاویر را مقایسه و تفاوتهایشان را تشخیص دهند، متن را به طور دقیق بخوانند، ویدیوهای طولانی را درک کنند و درک فضایی قوی داشته باشند، ارتقا میدهند.

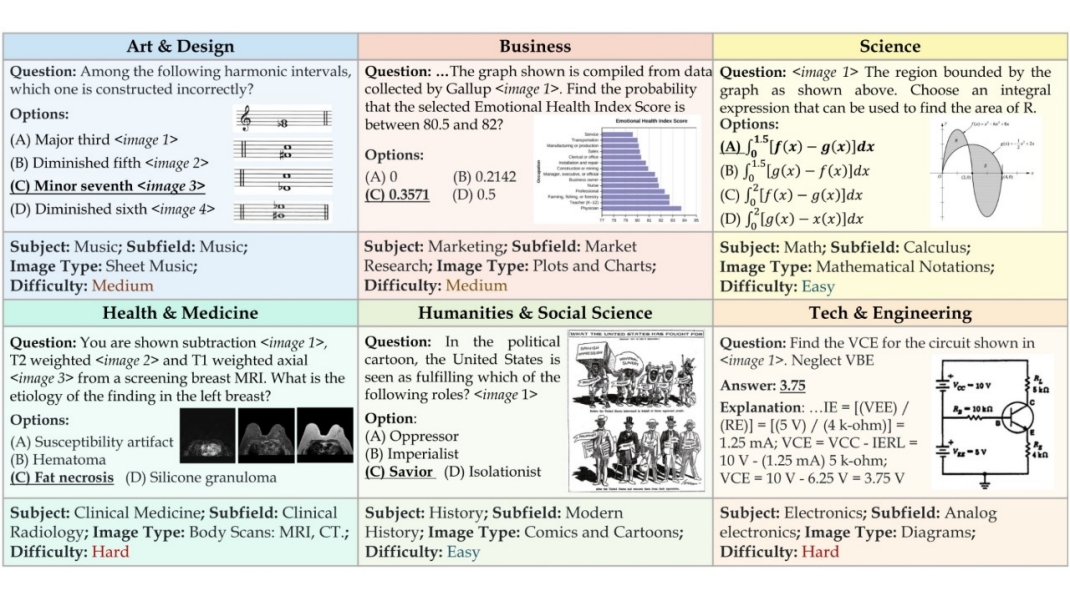

چگونه مدلهای زبانی بینایی بنچمارک میشوند؟

چندین معیار سنجش یا بنچ مارک رایج مانند MMMU، Video-MME، MathVista، ChartQA و DocVQA برای تعیین عملکرد مدلهای زبانی-بینایی در انواع وظایف وجود دارد، از جمله:

- پاسخگویی به سؤالات بصری

- منطق و استدلال

- درک اسناد

- مقایسههای چندتصویری

- درک ویدیو

اکثر معیارهای سنجش شامل مجموعهای از تصاویر با چندین سؤال مرتبط هستند که اغلب به صورت سؤالات چندگزینهای مطرح میشوند. قالب چندگزینهای سادهترین روش برای معیارسنجی مداوم و مقایسه VLMها است. این سؤالات، قابلیتهای ادراک، دانش و استدلال VLMها را آزمایش میکنند. هنگام اجرای این معیارهای سنجش، تصویر، سؤال و چندین پاسخ چندگزینهای که باید از میان آنها انتخاب کند، به VLM ارائه میشود.

دقت VLM تعداد انتخابهای صحیح در مجموعه سؤالات چندگزینهای است. برخی معیارهای سنجش همچنین شامل سؤالات عددی هستند که در آنها VLM باید محاسبه خاصی انجام دهد و در محدوده درصد مشخصی از پاسخ صحیح باشد تا درست در نظر گرفته شود. اغلب این سؤالات و تصاویر از منابع دانشگاهی، مانند کتابهای درسی سطح دانشگاهی گرفته شدهاند.

چگونه از مدلهای زبانی بینایی استفاده میشود؟

VLMها به سرعت در حال تبدیل شدن به ابزار اصلی برای انواع وظایف مرتبط با بینایی هستند، به دلیل انعطافپذیری و درک زبان طبیعی آنها. VLMها را میتوان به راحتی از طریق زبان طبیعی برای انجام طیف گستردهای از وظایف هدایت کرد:

- پاسخگویی به سؤالات بصری

- خلاصهسازی تصویر و ویدیو

- تجزیه و تحلیل متون و اسناد دستنویس

کاربردهای قبلی که نیاز به مجموعه بزرگی از مدلهای آموزشدیده خاص داشتند، اکنون میتوانند تنها با یک VLM انجام شوند.

VLMها به ویژه در خلاصهسازی محتوای تصاویر خوب عمل میکنند و میتوان آنها را برای انجام وظایف خاص بر اساس محتوا هدایت کرد. به عنوان مثال، در یک مورد استفاده آموزشی – یک VLM میتواند تصویری از یک مسئله ریاضی دستنویس دریافت کند و با استفاده از قابلیتهای OCR و استدلال خود، مسئله را تفسیر کرده و راهنمای گام به گام برای حل آن تولید کند. VLMها نه تنها میتوانند محتوای تصویر را درک کنند، بلکه میتوانند استدلال کرده و وظایف خاصی را انجام دهند.

با تولید حجم زیادی از ویدیو در هر روز، بررسی و استخراج بینش از این حجم ویدیو که توسط تمام صنایع تولید میشود، غیرعملی است. VLMها میتوانند در یک سیستم بزرگتر ادغام شوند تا عاملهای هوش مصنوعی تحلیل ویدیو را بسازند که قادر به تشخیص رویدادهای خاص هنگام درخواست هستند. این سیستمها میتوانند برای تشخیص روباتهای معیوب در یک انبار یا تولید هشدارهای اتمام موجودی هنگام خالی بودن قفسهها استفاده شوند. درک عمومی آنها فراتر از تشخیص ساده است و میتواند برای تولید گزارشهای خودکار استفاده شود. به عنوان مثال، یک سیستم هوشمند ترافیک میتواند خطرات ترافیکی مانند درختان افتاده، خودروهای متوقف شده یا تصادفات را تشخیص داده، تحلیل کرده و گزارش تولید کند.

VLMها میتوانند با فناوریهایی مانند پایگاههای داده گرافی برای درک ویدیوهای طولانی استفاده شوند. این به آنها کمک میکند تا پیچیدگی اشیاء و رویدادها در یک ویدیو را درک کنند. چنین سیستمهایی میتوانند برای خلاصهسازی عملیات در یک انبار جهت یافتن گلوگاهها و ناکارآمدیها یا تولید گزارش ورزشی برای بازیهای فوتبال، بسکتبال یا فوتبال استفاده شوند.

چالشهای مدلهای زبانی بینایی چیست؟

مدلهای زبانی بینایی به سرعت در حال بلوغ هستند، اما هنوز برخی محدودیتها، به ویژه در زمینه درک فضایی و درک ویدیو با زمینه طولانی دارند.

اکثر VLMها از مدلهای مبتنی بر CLIP به عنوان رمزگذار بینایی استفاده میکنند که به اندازه ورودی تصویر 224×224 یا 336×336 محدود هستند. این اندازه ورودی تصویر نسبتاً کوچک، تشخیص اشیاء کوچک و جزئیات را دشوار میکند. به عنوان مثال، یک فریم HD 1080×1920 از یک ویدیو باید به وضوح ورودی بسیار کوچکتری کاهش اندازه یا برش داده شود، که حفظ جزئیات برای اشیاء کوچک یا جزئیات ظریف را دشوار میکند. برای رفع این مشکل، VLMها در حال شروع به استفاده از روشهای کاشیکاری هستند که اجازه میدهند یک تصویر بزرگ به قطعات کوچکتر تقسیم شده و سپس به مدل تغذیه شود. همچنین تحقیقات مداومی برای بررسی استفاده از رمزگذارهای تصویر با وضوح بالاتر در جریان است.

VLMها همچنین در ارائه مکانهای دقیق برای اشیاء مشکل دارند. دادههای آموزشی برای رمزگذارهای بینایی مبتنی بر CLIP عمدتاً شامل توضیحات متنی کوتاه تصاویر، مانند زیرنویسها است. این توضیحات شامل مکانهای دقیق و جزئی اشیاء نیستند، و این محدودیت بر درک فضایی CLIP تأثیر میگذارد. این مشکل توسط VLMهایی که از آن به عنوان رمزگذار بینایی استفاده میکنند به ارث برده میشود. رویکردهای جدید در حال بررسی استفاده از ادغام چندین رمزگذار بینایی برای رفع این محدودیتها هستند (arxiv.org/abs/2408.15998).

درک ویدیوهای طولانی به دلیل نیاز به در نظر گرفتن اطلاعات بصری در طول ساعتهای احتمالی ویدیو برای تحلیل صحیح یا پاسخ به سؤالات چالشبرانگیز است. مانند LLMها، VLMها طول زمینه محدودی دارند—یعنی فقط تعداد مشخصی از فریمهای یک ویدیو میتواند برای پاسخ به سؤالات گنجانده شود. رویکردهایی برای افزایش طول زمینه و آموزش VLMها روی دادههای بیشتر مبتنی بر ویدیو در حال تحقیق هستند، مانند LongVILA (arxiv.org/abs/2408.10188).

VLMها ممکن است دادههای کافی برای موارد استفاده بسیار خاص، مانند یافتن نقصهای تولید در یک خط تولید خاص ندیده باشند. این محدودیت را میتوان با تنظیم دقیق VLM روی دادههای مختص دامنه (domain-specific data) یا استفاده از VLMهای چندتصویری با یادگیری در زمینه برای ارائه مثالهایی که میتوانند به مدل اطلاعات جدید آموزش دهند بدون آموزش صریح مدل، برطرف کرد. آموزش مدل روی دادههای مختص دامنه با PEFT تکنیک دیگری است که میتواند برای بهبود دقت یک VLM روی دادههای سفارشی استفاده شود.

چگونه میتوانید با مدلهای زبانی بینایی شروع کنید؟

مدلهای زبانی بینایی (VLM) انقلابی در دنیای هوش مصنوعی ایجاد کردهاند و یادگیری آنها به یکی از مهارتهای کلیدی متخصصان حوزه AI تبدیل شده است. اگر میخواهید در این زمینه پیشرفت کنید، به جای مناسبی آمدهاید!

کلاسویژن به عنوان پیشگام آموزش هوش مصنوعی در ایران، دورههای تخصصی مدلهای زبانی بینایی را با جدیدترین متدهای آموزشی و کاربردی برگزار میکند. در این دورهها شما:

- اصول پایهای مدلهای زبانی بینایی را فرا میگیرید

- با روشهای پیادهسازی و آموزش VLM آشنا میشوید

- پروژههای عملی با استفاده از تکنولوژیهای پیشرفته انجام میدهید

- مهارتهای لازم برای ورود به بازار کار AI را کسب میکنید

اگر علاقهمندید بهصورت گامبهگام و پروژهمحور وارد دنیای VLM و LLM شوید، دوره LLM و VLM کلاسویژن در مکتبخونه میتونه نقطه شروع فوقالعادهای باشه. توی این دوره از مفاهیم پایه گرفته تا مباحث پیشرفته مثل Fine-tuning، RLHF، PEFT و ساخت اپلیکیشنهای هوشمند آموزش داده میشه و بهزودی بخش تخصصی مدلهای زبانی بینایی (VLM) هم اضافه خواهد شد. با شرکت در این دوره، علاوه بر درک عمیق مفاهیم، تجربه عملی کار با ابزارهایی مثل Hugging Face رو هم بهدست میارید و آماده میشید که در پروژههای واقعی AI بدرخشید.

دیدگاهتان را بنویسید