الکسنت (AlexNet)

در ده ی گذشته، تحقیقات و سرمایه گذاری در حوزه هوش مصنوعی بهویژه پس از نتایج حیرت انگیز شبکه الکس نت در سال 2012 به عنوان اولین معماری موفق در حوزه دیپ لرنینگ در رقابت ImageNet افزایش یافته است.

در سال 2012، به لظف پروفسور جفری هینتون و شاگردش الکس کرجیوسکی، شبکه AlexNet با 8 لایه معرفی شد! از آنجایی که ما به شبکه های عصبی با بیش از 2 لایه پنهان عمیق میگوییم، این معماری قطعا یک شبکه عصبی عمیق یا همان یک شبکه ی در دیپ لرنینگی است). این شبکه با بهره گیری از مجموعه داده عظیم ایمیج نت و همچنین پیاده سازی برای پردازش موازی روی کارت گرافیکی یا GPU دو مشکل نبود داده و توان پردازش را حل کرده و با استفاده از ReLU به جای Sigmoid مشکل Vanishing Gradient را تا حد خوبی حل کرد. این شبکه در نهایت به طور قابل توجهی از تمام رقبای قبلی و آن سال پیشی گرفت و با کاهش top-5-error از 26٪ به 15.3٪، برنده چالش سال 2012 شد. رتبه دوم top-5-error که یک نوع CNN نبود، حدود 26.2٪ بوده است.

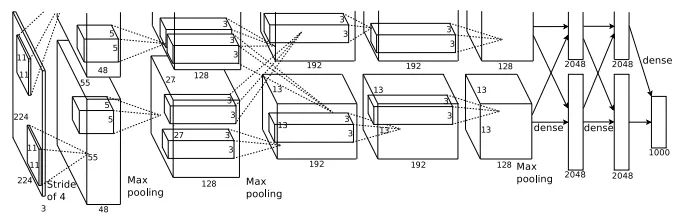

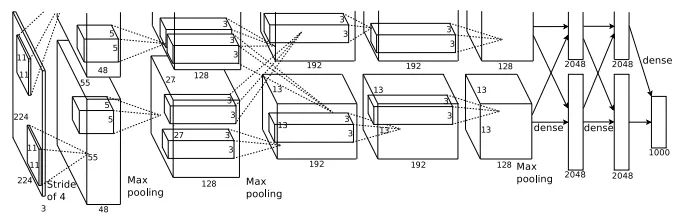

این شبکه معماری بسیار مشابهی با LeNet توسط Yann LeCun و همکاران داشت، اما عمیقتر، با فیلترهای بیشتر در هر لایه، و با لایههای کانولوشنالی بیشتر بود.

فیلترهای کانولوشنالی آن شامل 11×11 ، 5×5, 3×3 بوده است. استفاده از dropout برای جلوگیری از حفظ کردن داده نیز در این معماری دیده میشود.

AlexNet به مدت 6 روز به طور همزمان روی دو پردازنده گرافیکی Nvidia Geforce GTX 580 آموزش داده شد به همین دلیل شبکه آنها به دو قسمت تقسیم می شود. AlexNet توسط گروه SuperVision متشکل از Alex Krizhevsky، Geoffrey Hinton و Ilya Sutskever طراحی شده است.

اگر میخواهید پیرامون معماریهای مطرح شبکه های عصبی کانولوشنالی عمیق بیشتر بدانید، پست زیر را بخوانید:

دیدگاهتان را بنویسید